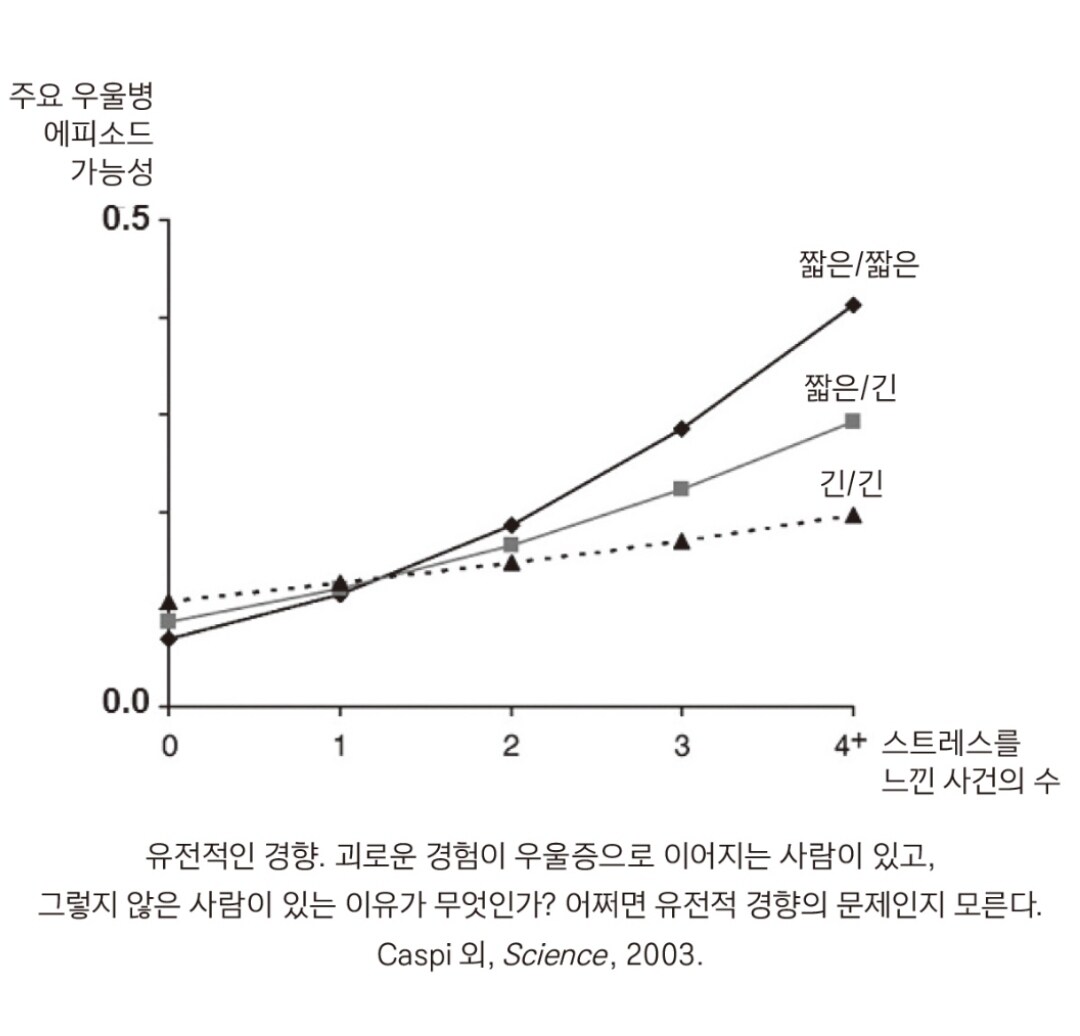

유전자와 환경의 상호작용

첫째, 긴 대립유전자가 ‘좋은 유전자’라서 유년기의 나쁜 환경에 맞설 수 있는 저항력을 준다는 것(아래 표에서 왼쪽 하단). 둘째, 나쁜 씨앗을 갖고 있는 원숭이에게 어미와의 좋은 관계가 어떻게든 저항력을 준다는 것(오른쪽 상단). 이 두 가지 해석은 서로 배타적인 관계가 아니라서, 함께 중요한 교훈으로 이어진다. 유전과 환경의 조합이 최종 결과에 중요한 역할을 한다는 교훈이다. - <무의식은 어떻게 나를 설계하는가>, 데이비드 이글먼 지음 / 김승욱 옮김 - 밀리의 서재

https://millie.page.link/WfsEC2wk8Ks16o3y7

카스피의 연구팀은 폭력을 저지르는 사람과 그렇지 않은 사람 사이의 차이를 알기 위한 연구에서, 특정 유전자의 발현에 나타난 작은 변화로 아이들이 달라진다는 사실을 발견했다.23 그 유전자가 잘 발현되지 않은 아이들은 행동 장애를 일으켜 폭력적인 범죄자가 될 가능성이 높았다. 만약 어려서 학대를 당했다면, 이런 나쁜 결과가 나올 가능성이 훨씬 더 높아졌다. 반면 ‘나쁜’ 형태의 유전자를 지니고 있으나 아동학대를 겪지 않았다면, 학대하는 어른으로 자랄 가능성이 낮았다. 그리고 ‘좋은’ 형태의 유전자를 지니고 있다면 어렸을 때 심한 학대를 당했어도 반드시 폭력을 이어가는 어른으로 자라지는 않았다. - <무의식은 어떻게 나를 설계하는가>, 데이비드 이글먼 지음 / 김승욱 옮김 - 밀리의 서재

https://millie.page.link/iyZs3MJ6fFxr5zN48

심리학자 앤절라 스카파와 에이드리언 레인은 비슷한 맥락에서, 반사회적 성격장애를 진단받은 사람들의 뇌기능에 어떤 차이가 있는지 측정해보았다. 반사회적 성격장애의 특징은 타인의 감정과 권리를 완전히 무시하는 행동을 보이며, 범죄자 집단에서 이 성격장애의 유병률이 높다. 연구팀은 과거의 불운한 환경 및 경험과 뇌 이상이 함께 존재할 때, 반사회적 성격장애가 발생할 확률이 가장 높다는 것을 알아냈다.25 뇌에 문제가 있지만 좋은 가정에서 자란다면, 아무 문제도 생기지 않을 가능성이 있다. 가정환경이 끔찍해도 뇌에 문제가 없다면, 역시 괜찮은 사람으로 자랄 수 있다. 그러나 뇌에 가벼운 이상이 있는 사람이 불행한 가정에서 자란다면, 몹시 불운한 시너지가 발생할 가능성이 높다.

이런 사례들은 성격이라는 최종 산물을 결정하는 것은 생물학적 현상과 환경 중 어느 하나만이 아님을 보여준다. - <무의식은 어떻게 나를 설계하는가>, 데이비드 이글먼 지음 / 김승욱 옮김 - 밀리의 서재

https://millie.page.link/o1su1jAyJU7kiUoC9