-

-

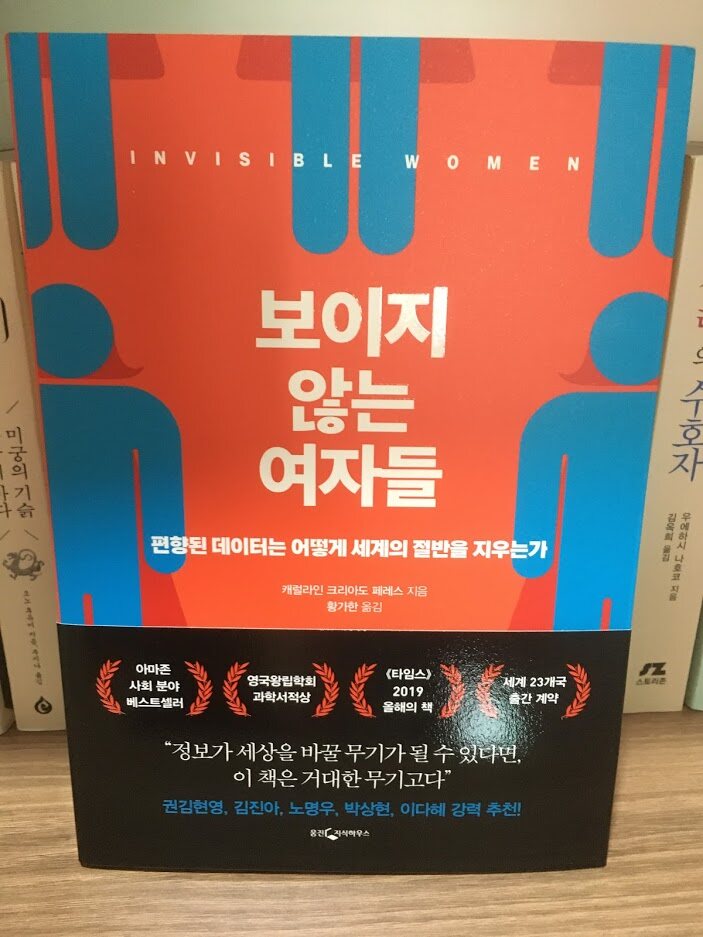

보이지 않는 여자들 - 편향된 데이터는 어떻게 세계의 절반을 지우는가

캐럴라인 크리아도 페레스 지음, 황가한 옮김 / 웅진지식하우스 / 2020년 7월

평점 :

“의사는 왜 여자의 말을 믿지 않는가 (마야 뒤센베리 著,김보은,이유림 共譯, 윤정원 監, 한문화, 원제 : Doing Harm)”를 통해 뿌리 깊게, 그리고 은밀하게 자리잡은 의료계 내부의 성편견에 대해 알 수 있는 기회가 되었습니다. 이 책의 추천사를 쓰고 감수를 맡은 윤정원 원장부터 본인이 의사였음에도 불구하고 여성이라는 이유로 진료를 받을 때 성편견을 겪었다고 하니 일반인은 말할 것도 없지요. 이 책에서 중요하게 다루었던 원인이 몇 가지가 있는데 그 중 하나가 바로 여성에 대한 지식의 간극, 쉽게 이야기해 ‘무지’입니다. 즉, 일반적으로 의사는 여성의 몸, 그리고 여성을 괴롭히는 질환이나 건강 문제를 잘 모른다는 것입니다. 애초에 가장 기초적인 수준의 생의학 연구부터 남성이나 수컷을 대상으로 연구하고 여성에 대해서는 남성과 같으리라고 생각하는 성별적 차이를 무시하는 비과학적 추정에 근거하기 때문이지요.

그러면 의료계 이외의 다른 분야는 어떨가요? 그 질문에 대한 답은 “보이지 않는 여자들 (캐럴라인 크리아도 페레스 著, 황가한 譯, 웅진지식하우스, 원제 : Invisible Women: Exposing Data Bias in a World Designed for Men)”에서 찾을 수 있을 것 같습니다. 사실 원제에 이 책의 주제가 드러나 있습니다. 남자들을 위해 설계된 세계에서의 데이터의 젠더 편향 혹은 성 편견에 대한 이야기입니다.

제가 읽었던 몇몇 책들에서도 지적한 바와 같이 이 책에서도 인류 역사에서 여성의 기록, ‘데이터가 누락되어서 생긴 커다란 구멍’이 있다고 이야기하고 있습니다. 예를 들어 사냥꾼, 전사라고 하면 으레 남자를 떠올립니다. 이건 젠더 편향적인 교육에 의해 세뇌된 집단 무의식의 결과에 가깝습니다. 최근 인류학의 성과에 의하면 고인류에 있어 ‘남자 사냥꾼 가설’ 등은 무너지고 있으며 여성 역시 동등한 혹은 우월한 경제 활동에서의 기여도를 가지고 있었으며 전투나 전쟁에서도 동등한 참여를 했다는 것이 점차 밝혀지고 있습니다. 얼마 전 남성 전사의 유골로 생각하다 DNA 검사에 의해 여성 전사의 유골임이 밝혀진 경우도 그 사례의 하나이겠지요. ( https://www.sciencealert.com/new-dna-analysis-reveals-an-ancient-scythian-warrior-was-a-13-year-old-girl?fbclid=IwAR0StS4t6MLAe9vBqTfrm4pedUYXpHx34hzURHSIKSyeT7QVwuHsqR8vP28 )

결국 이러한 여성의 데이터가 누락되면서 여성의 역할이 기록 속에서 사라져버리고, 남성이 인류의 전체를 대변하게 되는 결과를 낳게 됩니다. 인류의 나머지 반인 여성에 대해서는 ‘침묵’, 아니면 거대한 공백만 남게 됩니다.

이 책에서는 ‘젠더 데이터 공백’에 대한 사례를 일상, 직장, 설계, 의료, 공공 생활, 재난 등 다양한 분야에서 실증적으로 증명하며 주장하고 있습니다.

핑크 택스 (Pink Tax)라는 말이 있듯이 여성들은 더 열등한 서비스를 동일하거나 더 높은 가격을 주고 제공받는 경우가 많은 데 “음성인식”은 좋은 사례가 될 수 있을 것 같습니다. 책에 소개된 2016년 워싱턴 대학교 언어학과 연구원인 레이털 테트먼의 연구에 따르면 남성의 음성에 구글의 음성인식시스템이 정확하게 반응할 가능성이 여성의 그것보다 무려 70%나 높다는 사실을 발견하였습니다. 그런데 그나마 구글은 다른 음성인식시스템보다 그나마 나은 수준, 아니 시장에서 최고로 좋은 수준이었다고 합니다. 심지어 자동차 운행에 도움을 주는 차량 음성인식 시스템도 마찬가지입니다. 통계적으로 여성의 발음이 남성보다 정확하고 더 느리게 말하는데도 (이론적으로 보면 인식률이 더 높아야 정상입니다.) 이놈의 기계는 그걸 알아먹지 못합니다. 그 이유는 음성인식시스템의 학습 데이터가 바로 남성의 음성이었기 때문입니다. 단지 그 이유 하나입니다. 심지어 여성의 음성 데이터가 없는 것도 아닌데도 관행적이고 무의식적으로 ‘젠더 데이터 공백’을 유발시킨 것이지요. 음성인식시스템만 그런 젠더 데이터 공백이 일어날까요? 아닙니다. 책에 따르면 번역, 이력서 스캔, 인터넷 검색 등을 훈련시키는 대부분의 사례에서 일어난다고 합니다. 지금도 이러한 편향된 데이터가 지속적으로 축적되고 있습니다.

특히 최근 기계학습에 의해 발전하고 있는 AI에 있어 블랙박스 문제 (AI의 판단을 인간이 검증할수 없고 작동 방식을 이해할 수 없는 문제, 즉 AI의 판단에 ‘왜’에 대한 대답이 작동하지 않는 문제를 의미함)와 이 젠더 데이터 편향 혹은 공백이 맞물리게 된다면 앞으로 도래할 세상의 AI는 남성만을 인식하고 여성을 지워버릴지 모릅니다.

#보이지않는여자들, #케럴라인크리아도페레스, #황가한, #웅진지식하우스, #젠더편향, #성편견, #편향된데이터

※ 출판사로부터 도서를 제공받아 작성한 리뷰입니다